随着人工智能在基础设施和国家安全等敏感领域的使用呈爆炸式增长,卡内基梅隆大学的一个团队正在开拓人工智能安全响应领域。2023 年夏天,该大学软件工程研究所(第一个计算机应急响应小组 (CERT) 的诞生地)的研究人员认为,迫切需要成立一个新实体来领导研发工作,以定义事件响应策略人工智能和机器学习 (ML) 系统的技术和程序,并协调社区响应行动。仅仅六个多月后,Lauren McIlvenny 和 Gregory Touhill 在 2024 年 RSA 大会上分享了他们在运营世界上第一个人工智能安全事件响应团队 (AISIRT) 时学到的经验教训。

解释 AISIRT 的必要性AISIRT 的推出是因为 McIlvenny 和 Touhill 的研究数据显示人工智能驱动的攻击和针对人工智能系统的攻击持续增加。图希尔说:“我们继续看到许多与人工智能相关系统和技术相关的活动现在都成为了攻击目标。”两人提到了对 AI 聊天机器人和大型语言模型 (LLM) 系统等生成型 AI 工具构成的众多威胁,以及针对支持 AI 模型的引擎、图形处理单元 (GPU) 内核的攻击,其实现可能容易出现内存泄漏。并可用于访问敏感信息。AISIRT 是卡内基梅隆大学和 CERT 部门的合作伙伴网络合作开发的。它于 2023 年 8 月首次启动后开始部分运行,并自 2023 年 10 月起全面运行。它的重点是识别、理解和减轻国防和国家安全组织感兴趣并使用的人工智能系统的“漏洞”。在此背景下,麦克尔文尼解释说,“漏洞”包括传统软件漏洞、对抗性机器学习弱点以及导致联合网络人工智能攻击的缺陷。

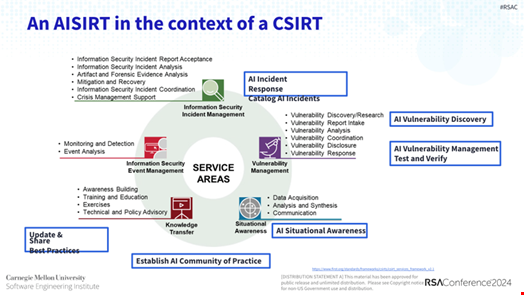

AISIRT 的运作方式AISIRT 利用网络事件响应的现有参与规则,其结构受到传统计算机安全事件和响应团队 (CSIRT) 的启发。它由四个主要组件组成:人工智能事件响应元素、人工智能漏洞发现工具集、人工智能漏洞管理框架和人工智能态势感知服务。

AISIRT 涉及各种利益相关者,包括:

团队领导者能够以受影响的各方可以理解的方式将技术方面的内容转化为受影响的各方

系统/数据库管理员

网络工程师

人工智能/机器学习从业者

威胁情报研究人员

来自卡内基梅隆大学和其他值得信赖的行业/学术合作伙伴的专家(根据需要)

McIlvenny 和 Touhill 表示,未来他们将 AISIRT 视为更新和共享国防和国家安全组织人工智能最佳实践、标准和指南的中心。他们计划在学术界、工业界、国防和国家安全组织以及立法机构中建立一个人工智能实践社区。“我们在 AISIRT 结构中展示的内容中至少有 20% 未来需要改进,”McIlvenny 估计。AISIRT 运行六个月后的经验教训McIlvenny 和 Touhill 分享了运行 AISIRT 六个多月后吸取的一些经验教训。这些是:

人工智能漏洞就是网络漏洞

整个系统都存在人工智能漏洞

网络安全流程已经成熟,应该继续发展以支持人工智能

人工智能系统在几个有趣的方面与当今的传统 IT 不同

人工智能系统的复杂性使分类、诊断和故障排除变得更加复杂

目前还没有识别漏洞的工具

需要为 AI 开发人员量身定制安全开发培训(即 DevSecOps)

红队在整个开发周期中对人工智能系统进行渗透测试可以在开发周期的早期发现重大缺陷

然而,他们坚称 AISIRT 以及整个人工智能安全仍处于起步阶段,使用人工智能的组织和试图防范人工智能威胁的利益相关者仍然有无数未解答的问题,包括以下问题:

新兴监管制度:使用人工智能系统的护理标准是什么,我们开发人工智能系统时的护理标准是什么?

不断变化的隐私影响:人工智能系统将如何影响维护公民的隐私权?人工智能系统将如何削弱现有的隐私保护协议?

知识产权威胁:如果我们宝贵的知识产权泄露到生成式人工智能系统中,我该怎么办?如果我们宝贵的知识产权在人工智能系统中被发现,我该怎么办?

治理和监督:人工智能治理和监督的最佳实践是什么?由于监管环境不同,我是否需要为欧洲和北美业务线建立单独的治理模型?

“我们正处于人工智能安全问题仍然远远多于答案的阶段,因此请与我们联系并分享您使用和保护人工智能的经验,”Touhill 总结道。

文章原文链接:https://www.anquanke.com/post/id/296341